对于高像素手机的追求,手机厂商可谓铆足了劲的追赶,特别是近2年,我们可以看到很多手机厂商都在宣传自家4800万像素、6400万像素甚至是一亿像素的手机。然而,苹果的iPhone却是一个例外,从iPhone 6S开始,苹果就一直沿用祖传的1200万像素,现在售价近万元iPhone 12系列依旧如此。这么多年iPhone像素一直没变,但是其综合拍照能力却处于第一梯队,这背后的原因到底是什么?

很多用户认为手机像素越高就越好,手机摄像头的像素固然对手机的成像有着很大的影响, 但要搞清楚的是,像素高并不意味着拍照就好。

像素是构成一张照片的最小单位。 我们看到的图片其实都是由每一个像素点组成,而每一个单独的“色点”就是我们常说的像素。一张图片由1200万个色点组成,那么图片像素就是1200万。

成像效果并非取决于像素高低,感光元件的大小更加重要。胶片时代感官元件指的是底片,而发展到现在的智能手机年代,感光元件就是指镜头后面用来接收光线的一块“小板”。

成像画质的好坏取决于感光元件捕捉到光的多少来决定,感光元件越大,能捕捉到的光线就越多,传感器感光性能越好,就能够带来更细腻的画质。同时,更大的底,在单个像素面积相同的条件下能堆积更多的像素点。

举个例子,iPhone 12 Pro Max虽然是1200万像素,苹果专门为其定制了一枚1/1.7英寸的大底传感器,其感光元件尺寸增大47%,像素尺寸增大至1.7 微米,低光拍摄效果更是提升高达87%。iPhone的像素虽然没变,但传感器等硬件却不断升级,这是其成像水平保持稳定在第一梯队的重要原因之一。

像素高只能证明图像承载的信息多、细节丰富,但并不能代表照片质量一定就高。手机的成像质量,除了受像素影响外,还与手机镜头本身、传感器感光元件、图像信号处理器以及软件算法等有关。

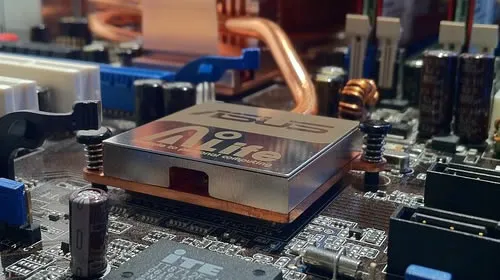

苹果供应链的整合能力是业界出了名的强,影像方面也毫不例外。 首先,财大气粗的苹果,对于iPhone零部件相来都是独家定制,目前主流手机厂商的传感器供货商只有少数的几家,而索尼是目前全球最大的影像传感器供货商,苹果同样采用索尼的CMOS,但是其素质却更好,同时也没有任何一家厂商能拿到和iPhone同样的模组,毕竟苹果对于其供应链要求是相当严苛的。

其次,苹果iPhone在软件算法上的积累同样深厚, 2017年iPhone X发布,A11仿生芯片也随之面世,之所以称其为“仿生”,是因为苹果在这款芯片上首次集成自研的Neural Engine神经网络引擎,其配合新型的ISP算法,iPhone X率先在业界实现了光照环境侦测等一系列拍照算法。

之后,A系列仿生芯片不断更新换代,其神经网络引擎算法对于拍照的优化也不断增强。例如,iPhone 12系列的智能HDR3算法,会利用机器学习技术,智能地调节照片的白平衡、对比度、质感和饱和度,让画面看上去更自然。

全新的计算摄影功能,所有摄像头均支持夜间模式和处理速度更快的深度融合技术,应对复杂场景下的拍摄能力进一步增强,苹果能够同时将这些功能算法集于一款手机上,足见其深厚的影像技术功底。

另一方面,新的手机摄像头、感光元件和软件算法之间的协同,任何一家手机厂商都不敢保证能在短时间内完全吃透,它需要花时间去打磨,而苹果而言这也不是问题。苹果不仅有来自于全球各地的优秀工程师,而且每年只更新一代产品,影像团队有充足的时间去优化产品,相比于其他手机厂商一年发多款产品,苹果显然更有时间上的优势。

定制的镜头、传感器感光元件等硬件,配合影像技术上的深度调教,再加上通过收购吸纳全世界优秀的影像技术团队,最终打造出一套完整的iPhone影像系统。